Inteligência Artificial é a nova estrela da dark web

As contas ChatGPT roubadas e os serviços que oferecem a sua criação automatizada em massa estão a inundar os canais atingindo mais de 3000 mensagens.

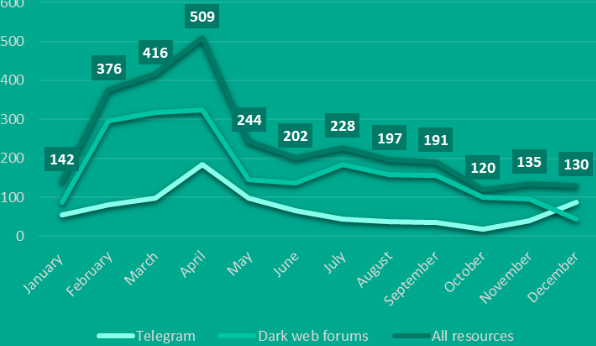

O serviço Digital Footprint Intelligence da Kaspersky encontrou cerca de 3000 publicações na dark web sobre a utilização do ChbatGPT e de outros modelos de inteligência artificial para atividades ilegais.

Os atacantes estão a explorar esquemas que vão desde a criação de alternativas nefastas ao chatbot até ao jailbreak da versão original do ChatGPT, e muito mais.

As contas ChatGPT roubadas e os serviços que oferecem a sua criação automatizada em massa também estão a inundar os canais da dark web, atingindo mais de 3000 mensagens, diz a Kaspersky.

“Os cibercriminosos estão a explorar ativamente vários esquemas para implementar o ChatGPT e a IA nas suas atividades maliciosas. Os tópicos incluem frequentemente o desenvolvimento de malware e outros tipos de utilização ilícita de modelos de linguagem, como o processamento de dados roubados, a análise de ficheiros de dispositivos infetados, entre outros”, explica Alisa Kulishenko, especialista em pegada digital da Kaspersky.

Além disso, segundo a mesma especialista, “os cibercriminosos tendem a partilhar jailbreaks (violações) através de vários canais da dark web e a conceber formas de explorar ferramentas legítimas, com base em modelos, para fins maliciosos”.

Para além do chatbot e da inteligência artificial mencionados, está a ser dada uma atenção considerável a projetos como o XXXGPT, o FraudGPT, entre outros.

Estes modelos de linguagem são comercializados na dark web como alternativas ao ChatGPT, ostentando funcionalidades adicionais e a ausência de limitações originais.

Uma outra ameaça para os utilizadores e as empresas, diz ainda a Kaspersky é o mercado de contas para a versão paga do ChatGPT. Em 2023, foram identificadas mais 3000 mensagens (para além das anteriormente mencionadas) que anunciavam a venda de contas ChatGPT na dark web e nos canais sombra do Telegram.

Estas mensagens distribuem contas roubadas e promovem serviços de registo automático que criam contas em massa a pedido. Nomeadamente, alguns posts foram publicados repetidamente em vários canais da dark web.

Embora as ferramentas de IA em si não sejam inerentemente perigosas, os cibercriminosos estão a tentar encontrar formas eficientes de utilizar modelos de linguagem, “alimentando assim uma tendência para reduzir a barreira de entrada no cibercrime e, em alguns casos, aumentar potencialmente o número de ciberataques”.

No entanto, na opinião de Alisa Kulishenko, “é pouco provável que a IA generativa e os chatbots revolucionem o panorama dos ataques – pelo menos em 2024”.

Na opinião da mesma especialista, “a natureza automatizada dos ciberataques significa frequentemente defesas automatizadas. No entanto, manter-se informado sobre as atividades dos atacantes é crucial para estar à frente dos adversários em termos de cibersegurança empresarial”.